🤖 Wizey vs DeepSeek R1 — ¿El razonamiento en IA ayuda a interpretar laboratorios?

Cuando DeepSeek publicó su modelo de razonamiento R1 a principios de 2025, sacudió a la industria de la IA. Pesos abiertos bajo licencia MIT, precios un orden de magnitud por debajo de los competidores estadounidenses cerrados y una cadena de pensamiento visible (CoT — el modelo «pensando en voz alta» antes de responder) con un rendimiento en matemáticas a la altura de los sistemas de razonamiento cerrados de OpenAI. Nuestro equipo de ingeniería pasó semanas sometiéndolo a pruebas de estrés para responder a una sola pregunta: ¿esta arquitectura realmente pertenece a un pipeline de IA médica?

La familia DeepSeek ha crecido desde entonces. Para la primavera de 2026, la gama incluye DeepSeek V4 con un modo de razonamiento híbrido y ventana de contexto de 1 M tokens, V3.2-Speciale (medalla de oro en la IMO 2025) y un R2 compacto de 32B parámetros que corre en una única GPU de consumo. La tecnología es genuinamente impresionante. Pero «tecnología impresionante» y «apropiada para la medicina» no son la misma afirmación.

En este artículo recorro los aspectos de ingeniería de DeepSeek R1 y sus sucesores: cómo se entrena el razonamiento, dónde los pesos abiertos cambian las reglas del juego, por qué la cadena de pensamiento es un arma de doble filo en contextos clínicos y cómo se compara el pipeline estructurado de Wizey. Para los fundamentos de cómo los LLM generalistas manejan los informes de laboratorio — RAG, Lost in the Middle, alucinaciones, HIPAA/GDPR — consulta nuestra pieza pilar sobre Wizey vs ChatGPT para IA médica.

Qué hace arquitectónicamente diferente a DeepSeek R1

La diferencia principal es el razonamiento. Un LLM estándar va de «prompt → respuesta». R1 primero genera una larga cadena de pensamiento interna — a menudo de 2.000 a 10.000 tokens — y solo entonces emite la respuesta final. Puedes verlo directamente en la API: un bloque <think> muestra al modelo deliberando como un profesor resolviendo un problema en una pizarra.

Por dentro, R1 está construido sobre DeepSeek V3 con un backbone Mixture of Experts (MoE). El modelo alberga muchos «submodelos» especializados y enruta cada consulta solo al subconjunto que necesita, que es cómo se obtienen cientos de miles de millones de parámetros totales con un coste de inferencia moderado. La propia capacidad de razonamiento no se entrenó mediante fine-tuning supervisado clásico, sino a través de aprendizaje por refuerzo con GRPO (Group Relative Policy Optimization), descrito en el artículo original de DeepSeek R1 en arXiv y publicado después en Nature. Simplificando: no se enseñó al modelo las «respuestas correctas» — se le recompensó por llegar a respuestas correctas, y descubrió por sí mismo estrategias como la autocomprobación, la enumeración de hipótesis y la vuelta atrás.

La segunda diferencia estructural son los pesos abiertos. Cada lanzamiento de DeepSeek (V3, R1, V3.2, V4, R2) se publica en Hugging Face bajo licencia MIT. Cualquier empresa puede descargar los pesos, ejecutarlos en su propia infraestructura, ajustarlos para una tarea específica y no pagar nada al proveedor por la inferencia. Para los modelos de frontera cerrados (GPT, Claude, Gemini) esto es arquitectónicamente imposible.

Dónde ganan de verdad los pesos abiertos: privacidad y despliegue on-premise

Los pesos abiertos no son retórica de marketing — cambian la economía y la historia del cumplimiento. Este es el punto donde creo que DeepSeek es más fuerte, y donde la cobertura mayoritaria tiende a minimizar las implicaciones.

En el flujo en la nube — chat.deepseek.com o la API — la privacidad se ve igual que con cualquier otro proveedor: tus datos van a los servidores de DeepSeek bajo la legislación china de protección de datos. Para datos médicos de EE. UU. o europeos, eso es un alto definitivo: ni HIPAA ni GDPR toleran el procesamiento transfronterizo incontrolado de información de salud protegida.

Los pesos abiertos cambian el panorama por completo. Puedes desplegar el modelo en tu propio hardware — un centro de datos hospitalario, un laboratorio de investigación, incluso la estación de trabajo de un médico — y ningún byte del expediente del paciente sale de tu perímetro. Objetivos prácticos de hardware:

- DeepSeek-R1-Distill-Llama-8B (destilado — un modelo más pequeño entrenado para imitar al grande): unos 6 GB de VRAM, corre en una RTX 3060 o mejor.

- DeepSeek-R1-Distill-32B: aproximadamente 20 GB de VRAM — RTX 3090, RTX 4090 o una T4/A10 de grado servidor.

- DeepSeek-R1-Distill-70B: alrededor de 40 GB de VRAM — dos RTX 4090 o una A100.

- DeepSeek-R1 completo (671B MoE): un servidor multi-H100/A100 con más de 1 TB de memoria agregada. Irreal para un laboratorio casero, normal para un centro de datos clínico.

- R2 a 32B: cabe en una única RTX 4090 de consumo (24 GB de VRAM) acercándose a la calidad de frontera.

Compáralo con los modelos de frontera cerrados: para GPT-5 o Claude Opus no puedes «descargar el modelo» en absoluto — cada solicitud debe llegar a la nube del proveedor. Con DeepSeek puedes instalar Ollama o vLLM en un servidor dentro de tu red, conectar un front-end local y mantener todo el flujo de trabajo aislado de internet. Esa es la única ruta práctica para ejecutar un LLM de primer nivel respetando plenamente HIPAA y GDPR — y es una ventaja real para los equipos de TI hospitalaria que evalúan IA médica.

Dentro de Wizey probamos variantes destiladas de R1 como parte de una vía de investigación interna. La calidad es inferior a la de los modelos cerrados de primer nivel, pero para tareas bien acotadas — preprocesamiento anonimizado, resumen interno — el modelo local es una herramienta funcional.

Dónde DeepSeek supera a los modelos cerrados de frontera

Para evitar una redacción sesgada: R1 y sus sucesores no son un «clon barato de GPT». En varias dimensiones son objetivamente fuertes.

- Coste. El precio actual de DeepSeek V4 está aproximadamente un orden de magnitud por debajo de los niveles superiores de OpenAI y Anthropic. Para cargas de trabajo de alto volumen, esta es la diferencia entre un producto que llega al mercado y uno que no.

- Matemáticas y lógica formal. En AIME, MATH-500, SWE-bench y GPQA Diamond, R1/R2 igualan a los modelos de razonamiento de OpenAI. Para la medicina esto importa: cálculos de TFGe, dosis basadas en peso, conversiones de unidades — estas son tareas matemáticas en las que la CoT ayuda de verdad.

- Transparencia del razonamiento. La traza de CoT se devuelve al llamador, de modo que puedes auditar dónde se descarrió la lógica. Los modelos de la serie o de OpenAI ocultan el razonamiento detrás de la API.

- Capacidad de fine-tuning. Como los pesos son abiertos, los grupos de investigación médica pueden continuar el preentrenamiento y el RLHF sobre corpus clínicos verificados. Eso es estructuralmente imposible para los modelos cerrados.

Son victorias reales. La pregunta es si suman a una herramienta de grado clínico, y ahí la historia se complica.

Razonamiento vs alucinación: ¿ayuda la cadena de pensamiento en medicina?

Esta es la pregunta central del artículo y donde tengo los sentimientos más encontrados como ingeniero.

La buena noticia. El gran estudio de 2025 «Medical Hallucinations in Foundation Models» encontró que la cadena de pensamiento reducía las tasas de alucinación médica en el 86 % de los casos evaluados. En promedio, el razonamiento explícito hace que la respuesta sea más precisa. R1 obtuvo resultados de referencia sólidos para resistencia a alucinaciones — mejores que la mayoría de los modelos de generaciones anteriores.

La mala noticia. La CoT también oscurece la señal de alucinación. Los métodos clásicos de detección — confianza a nivel de token, entropía de salida — dejan de funcionar bien, porque el modelo escribe texto fluido e internamente coherente incluso cuando la conclusión es errónea. El análisis de limitaciones de ChatGPT en entornos clínicos de The Lancet Digital Health ya mostró que la confianza narrativa es un mal indicador de la veracidad médica. Los modelos de razonamiento amplifican esto.

La muy mala noticia. Los análisis de alucinaciones de IA en 2025 convergen en un hallazgo concreto: los modelos de lenguaje son aproximadamente un 34 % más propensos a usar fraseo confiado («definitivamente», «sin duda», «claramente») precisamente cuando están equivocados. Los modelos de razonamiento lo empeoran: una traza larga y de apariencia reflexiva hace que la respuesta final parezca más autorizada incluso cuando la CoT se desvía en el paso 3 y luego camina coherentemente en la dirección equivocada durante otros 2.000 tokens.

En medicina, ese es el modo de fallo crítico. Imagina: el modelo «razona» 3.000 tokens sobre tu fosfatasa alcalina elevada, construye un diagnóstico diferencial elegante sobre causas posibles y concluye con osteomalacia — porque en el paso 3 de la CoT mezcló el rango de referencia de adulto con el pediátrico. La salida se lee como una nota de consulta de un médico. Es incorrecta. Sin CoT, el mismo modelo podría haber dado una respuesta más vaga y menos confiada — y un paciente sería más propenso a pedir seguimiento en vez de anclarse en la conclusión.

La disyuntiva es real: el razonamiento reduce la tasa media de alucinaciones pero aumenta la persuasividad de las que quedan. Para tareas puramente técnicas (matemáticas, código) es un canje aceptable. Para la medicina, el coste de un error es asimétrico, y eso cambia el cálculo.

Prueba de escenario: el mismo panel de laboratorio por R1 vs Wizey

En concreto — un escenario que probé durante la evaluación técnica.

El panel: un panel real (desidentificado) metabólico completo + hemograma + ferritina + TSH + T4 libre + PCR + homocisteína + vitamina D + B12 + perfil lipídico, 47 marcadores en total. Varias anomalías: ferritina elevada a 320 ng/mL, PCR moderadamente elevada a 8,5 mg/L, TSH cerca del límite superior a 4,1 mIU/L, homocisteína 14 µmol/L.

DeepSeek R1 a través de la interfaz de chat (inglés, el idioma más fuerte del modelo):

- CoT de unos 4.500 tokens, recorriendo cada marcador y construyendo asociaciones.

- Conclusión final: señaló la ferritina como «posible sobrecarga de hierro o inflamación crónica», la vinculó correctamente con la PCR, pero propuso hemocromatosis como diagnóstico diferencial de primera línea (una afección genética rara) a partir de un único valor de ferritina.

- Interpretó la TSH 4,1 como «dentro del rango normal», obviando que 4,1 con homocisteína limítrofe e inflamación justifica un estudio de anticuerpos anti-TPO y una repetición a las 6–8 semanas — el estudio estándar del hipotiroidismo subclínico.

- La homocisteína de 14 no fue señalada como digna de atención (muchos laboratorios usan < 10 como óptimo).

- El modelo añadió repetidamente la coletilla de «consulte a un profesional sanitario», pero entre esos descargos emitió hipótesis muy específicas con un tono confiado.

El mismo panel por el pipeline de Wizey:

- Los 47 marcadores se parsearon en una tabla estructurada contra rangos de referencia específicos por edad y sexo.

- Ferritina con PCR elevada interpretada correctamente: descartar primero la inflamación (comportamiento de reactante de fase aguda), luego considerar sobrecarga de hierro. La hemocromatosis solo se plantea tras confirmar la saturación de transferrina y las pruebas genéticas — no a partir de un único valor de ferritina.

- TSH 4,1 destacada como limítrofe con una recomendación explícita de repetirla con anticuerpos anti-TPO.

- Homocisteína 14 señalada como ligeramente elevada con la vía B12/folato/B6 y la sugerencia de revisar esos cofactores.

- Cada afirmación está ligada a una fuente específica del grafo de conocimiento médico (guías clínicas, referencias de NCBI StatPearls sobre reactantes de fase aguda, revisiones de Nature Medicine).

La diferencia no es que DeepSeek sea «más tonto» — es un modelo capaz. La diferencia es que un modelo de razonamiento generalista no tiene barandillas integradas para la conversión de unidades, la selección del rango de referencia o una jerarquía bayesiana de hipótesis diagnósticas. Razona. Wizey sigue protocolos — y usa el razonamiento solo donde un protocolo verificado dice que el razonamiento es apropiado.

Cuándo DeepSeek R1 es la herramienta adecuada

Quiero ser justo. Varios escenarios donde DeepSeek — especialmente desplegado localmente — es realmente la opción correcta:

- Entornos clínicos o de I+D aislados (air-gapped). Si tu organización tiene requisitos estrictos de privacidad, un R1-Distill-32B local o R2 en tu propio servidor da una calidad cercana a la de frontera sin enviar un solo byte a un tercero. Este es el camino más práctico hacia el cumplimiento de HIPAA/GDPR con un LLM de última generación.

- Base para fine-tuning de dominio. Los pesos abiertos permiten a los grupos de investigación médica continuar el preentrenamiento sobre corpus clínicos validados y construir sus propias pilas de RLHF. Esa opción no existe para los modelos cerrados.

- Subtareas técnicas dentro de un pipeline médico. Cálculos de dosis, conversión de unidades, puntuaciones de riesgo como CHA2DS2-VASc o Wells — módulos aislados de matemáticas/lógica donde el razonamiento ayuda. Úsalo como componente, no como el «médico».

- Traducción y explicación de terminología — en esto el modelo está a la altura de los sistemas de frontera.

- Cargas sensibles al coste — si necesitas ejecutar millones de solicitudes, la diferencia de precio frente a los modelos de frontera cerrados se convierte en decenas de miles de dólares al mes.

Lo que no haría: pegar el PDF de laboratorio de un paciente real en el chat en la nube de DeepSeek y tratar la salida como una respuesta clínica. Entre el flujo transfronterizo de datos, el modo de fallo «persuasivo pero incorrecto» de la CoT, la ausencia de certificación de producto sanitario y la falta de disciplina en los rangos de referencia, es una mala elección para el caso de uso de consumidor. Para un paciente que quiere «enviar el laboratorio a un bot y obtener una respuesta», un servicio médico construido expresamente para ello es la herramienta adecuada.

Cómo usa el razonamiento Wizey — dentro de un protocolo, no en lugar de uno

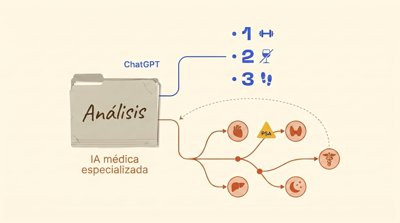

La pregunta que más recibo: ¿Wizey también usa razonamiento internamente? Sí — pero restringido. Nuestro pipeline se ve así:

- OCR y extracción. Cada valor del PDF se parsea de forma determinista y se mapea a un esquema estructurado (estilo LOINC) con su rango de referencia específico del laboratorio.

- Vinculación al rango de referencia. Cada valor se evalúa contra el rango correcto según la edad, el sexo y (cuando corresponde) el estado de embarazo o renal del paciente. Esto es código, no salida de LLM.

- RAG sobre un grafo de conocimiento clínico validado. Cada afirmación del informe final está anclada en una fuente específica — guía, artículo revisado por pares, entrada de StatPearls — no en generación libre.

- Razonamiento para cadenas diagnósticas, dentro de barandillas. Aquí es donde el pensamiento tipo CoT se gana su sustento: construir un diferencial bayesiano donde el prior y la verosimilitud vienen del grafo de conocimiento, no de la opinión del modelo.

- Salidas ligadas al protocolo. El texto final está ligado al resultado estructurado. El modelo no tiene permiso para inventar un diagnóstico que el protocolo no haya sancionado.

Esa arquitectura hace dos cosas a la vez. Captura la verdadera ventaja del razonamiento — lógica diagnóstica paso a paso, cálculos seguros en unidades, conciencia de la covariación entre marcadores — a la vez que corta el modo de fallo concreto que hace arriesgado un modelo de razonamiento puro en medicina: una cadena de pensamiento larga, persuasiva e internamente coherente que es incorrecta porque las premisas nunca se verificaron.

Conclusión

DeepSeek es un trabajo técnicamente impresionante, y me alegra genuinamente que la industria tenga una alternativa de código abierto a los modelos de frontera cerrados. El despliegue local desbloquea opciones de privacidad y fine-tuning que los usuarios de modelos cerrados simplemente no tienen, y eso importa para los hospitales, los grupos de investigación y cualquiera que tome en serio la soberanía de datos.

Pero el razonamiento por sí solo no resuelve el problema médico. Una cadena de pensamiento larga y bien formada sobre premisas erróneas sigue siendo una respuesta errónea — solo mejor envuelta. Para el trabajo de leer los laboratorios de un paciente concreto, donde cada número, cada rango de referencia y cada diferencial importa, el equipo de Wizey tomó una ruta distinta: un pipeline especializado con RAG sobre fuentes clínicas verificadas y barandillas de protocolo estrictas. Para el paciente, eso se traduce en una promesa concreta — cada afirmación del informe puede mostrarse a un médico y rastrearse hasta una fuente.