🤖 Wizey vs DeepSeek R1 — le raisonnement IA aide-t-il à interpréter les analyses ?

Lorsque DeepSeek a publié son modèle de raisonnement R1 au début de 2025, cela a secoué l’industrie de l’IA. Poids ouverts sous licence MIT, prix d’un ordre de grandeur inférieur à ceux des concurrents américains fermés, et une chaîne de pensée visible (CoT — le modèle « pensant à voix haute » avant de répondre) avec des performances en mathématiques au niveau des systèmes de raisonnement fermés d’OpenAI. Notre équipe d’ingénierie a passé des semaines à le mettre à l’épreuve pour répondre à une seule question : cette architecture a-t-elle réellement sa place dans un pipeline d’IA médicale ?

La famille DeepSeek a grandi depuis. Au printemps 2026, la gamme inclut DeepSeek V4 avec un mode de raisonnement hybride et une fenêtre de contexte de 1 M tokens, V3.2-Speciale (médaille d’or à l’IMO 2025), et un R2 compact à 32B paramètres qui tourne sur une seule GPU grand public. La technologie est réellement impressionnante. Mais « technologie impressionnante » et « adaptée à la médecine » ne sont pas la même affirmation.

Dans cet article, je passe en revue les spécificités d’ingénierie de DeepSeek R1 et de ses successeurs : comment le raisonnement est entraîné, où les poids ouverts changent la donne, pourquoi la chaîne de pensée est une arme à double tranchant en contexte clinique, et comment se compare le pipeline structuré de Wizey. Pour les bases sur la manière dont les LLM généralistes gèrent les bilans biologiques — RAG, Lost in the Middle, hallucinations, HIPAA/RGPD — voyez notre pièce pilier sur Wizey vs ChatGPT pour l’IA médicale.

Ce qui rend DeepSeek R1 architecturalement différent

La principale différence est le raisonnement. Un LLM standard va de « prompt → réponse ». R1 génère d’abord une longue chaîne de pensée interne — souvent 2 000 à 10 000 tokens — et n’émet qu’ensuite la réponse finale. Vous le voyez directement dans l’API : un bloc <think> montre le modèle en train de délibérer comme un enseignant qui travaille un problème au tableau.

Sous le capot, R1 est construit sur DeepSeek V3 avec un backbone Mixture of Experts (MoE). Le modèle héberge de nombreux « sous-modèles » spécialisés et ne route chaque requête que vers le sous-ensemble dont elle a besoin, ce qui permet d’avoir des centaines de milliards de paramètres totaux avec un coût d’inférence modéré. La capacité de raisonnement elle-même n’a pas été entraînée par un fine-tuning supervisé classique mais par apprentissage par renforcement avec GRPO (Group Relative Policy Optimization), décrit dans l’article original DeepSeek R1 sur arXiv puis publié dans Nature. En simplifiant : on n’a pas enseigné au modèle les « bonnes réponses » — on l’a récompensé pour avoir atteint de bonnes réponses, et il a découvert de lui-même des stratégies comme l’auto-vérification, l’énumération d’hypothèses et le retour en arrière.

La seconde différence structurelle, ce sont les poids ouverts. Chaque sortie DeepSeek (V3, R1, V3.2, V4, R2) est publiée sur Hugging Face sous licence MIT. N’importe quelle entreprise peut télécharger les poids, les exécuter sur sa propre infrastructure, les affiner pour une tâche précise, et ne rien payer au fournisseur pour l’inférence. Pour les modèles de pointe fermés (GPT, Claude, Gemini), c’est architecturalement impossible.

Là où les poids ouverts gagnent réellement : confidentialité et déploiement on-premise

Les poids ouverts ne sont pas de la rhétorique marketing — ils changent l’économie et le récit de la conformité. C’est le point où DeepSeek me paraît le plus fort, et où la couverture grand public tend à minimiser les implications.

Dans le flux cloud — chat.deepseek.com ou l’API — la confidentialité ressemble à celle de n’importe quel autre fournisseur : vos données partent vers les serveurs de DeepSeek sous la législation chinoise de protection des données. Pour des données médicales américaines ou européennes, c’est un arrêt net : ni HIPAA ni RGPD ne tolèrent un traitement transfrontalier non contrôlé d’informations de santé protégées.

Les poids ouverts changent la donne complètement. Vous pouvez déployer le modèle sur votre propre matériel — un centre de données hospitalier, un laboratoire de recherche, même la station de travail d’un médecin — et aucun octet du dossier patient ne quitte votre périmètre. Cibles matérielles pratiques :

- DeepSeek-R1-Distill-Llama-8B (distillé — un modèle plus petit entraîné à imiter le grand) : environ 6 Go de VRAM, tourne sur une RTX 3060 ou mieux.

- DeepSeek-R1-Distill-32B : environ 20 Go de VRAM — RTX 3090, RTX 4090 ou une T4/A10 de classe serveur.

- DeepSeek-R1-Distill-70B : autour de 40 Go de VRAM — deux RTX 4090 ou une A100.

- DeepSeek-R1 complet (671B MoE) : un serveur multi-H100/A100 avec plus de 1 To de mémoire agrégée. Irréaliste pour un labo à domicile, ordinaire pour un centre de données clinique.

- R2 à 32B : tient sur une seule RTX 4090 grand public (24 Go de VRAM) tout en approchant la qualité de pointe.

À comparer aux modèles de pointe fermés : pour GPT-5 ou Claude Opus, vous ne pouvez pas « télécharger le modèle » du tout — chaque requête doit atteindre le cloud du fournisseur. Avec DeepSeek, vous pouvez installer Ollama ou vLLM sur un serveur à l’intérieur de votre réseau, brancher une interface locale, et garder l’ensemble du flux de travail coupé d’internet. C’est la seule voie pratique pour faire tourner un LLM de premier plan tout en respectant pleinement HIPAA et RGPD — et c’est un vrai avantage pour les équipes informatiques hospitalières qui évaluent l’IA médicale.

Chez Wizey, nous avons testé des variantes distillées de R1 dans le cadre d’une piste de recherche interne. La qualité est inférieure à celle des modèles fermés phares, mais pour des tâches bien cadrées — prétraitement anonymisé, résumé interne — le modèle local est un outil opérationnel.

Là où DeepSeek bat les modèles de pointe fermés

Pour éviter un compte-rendu unilatéral : R1 et ses successeurs ne sont pas un « clone bon marché de GPT ». Sur plusieurs dimensions, ils sont objectivement forts.

- Coût. Le prix actuel de DeepSeek V4 est environ un ordre de grandeur en dessous des paliers supérieurs d’OpenAI et d’Anthropic. Pour des charges de gros volume, c’est la différence entre un produit qui sort et un produit qui ne sort pas.

- Mathématiques et logique formelle. Sur AIME, MATH-500, SWE-bench et GPQA Diamond, R1/R2 égalent les modèles de raisonnement d’OpenAI. Pour la médecine c’est important : calculs de DFGe, posologies basées sur le poids, conversions d’unités — autant de tâches mathématiques où la CoT aide vraiment.

- Transparence du raisonnement. La trace de CoT est renvoyée à l’appelant, si bien que vous pouvez auditer l’endroit où la logique a déraillé. Les modèles de la série o d’OpenAI cachent le raisonnement derrière l’API.

- Capacité de fine-tuning. Comme les poids sont ouverts, les groupes de recherche médicale peuvent continuer le pré-entraînement et le RLHF sur des corpus cliniques vérifiés. C’est structurellement impossible pour les modèles fermés.

Ce sont de vraies victoires. La question est de savoir si elles s’additionnent en un outil de niveau clinique, et c’est là que l’histoire se complique.

Raisonnement vs hallucination : la chaîne de pensée aide-t-elle en médecine ?

C’est la question centrale de l’article et celle qui me laisse les sentiments les plus mitigés en tant qu’ingénieur.

La bonne nouvelle. La vaste étude de 2025 « Medical Hallucinations in Foundation Models » a trouvé que la chaîne de pensée réduisait les taux d’hallucination médicale dans 86 % des cas testés. En moyenne, le raisonnement explicite rend la réponse plus exacte. R1 a affiché des résultats de référence solides pour la résistance aux hallucinations — meilleurs que la plupart des modèles de la génération précédente.

La mauvaise nouvelle. La CoT occulte aussi le signal d’hallucination. Les méthodes classiques de détection — confiance au niveau du token, entropie de sortie — cessent de bien fonctionner, car le modèle écrit un texte fluide et cohérent en interne même lorsque la conclusion est fausse. L’analyse des limites de ChatGPT en contexte clinique du Lancet Digital Health avait déjà montré que la confiance narrative est un mauvais indicateur de la véracité médicale. Les modèles de raisonnement amplifient cela.

La très mauvaise nouvelle. Les analyses d’hallucinations IA en 2025 convergent vers un constat précis : les modèles de langage sont environ 34 % plus susceptibles d’utiliser des formulations assurées (« définitivement », « sans aucun doute », « clairement ») précisément lorsqu’ils ont tort. Les modèles de raisonnement aggravent cela : une trace longue et d’apparence réfléchie rend la réponse finale plus autoritaire, même lorsque la CoT part en vrille à l’étape 3 et avance ensuite de façon cohérente dans la mauvaise direction sur encore 2 000 tokens.

En médecine, c’est le mode d’échec critique. Imaginez : le modèle « raisonne » 3 000 tokens sur votre phosphatase alcaline élevée, bâtit un diagnostic différentiel élégant autour des causes possibles, et conclut par une ostéomalacie — parce qu’à l’étape 3 de la CoT il a confondu la plage de référence adulte avec la plage pédiatrique. La sortie se lit comme la note d’un médecin consultant. C’est faux. Sans CoT, le même modèle aurait pu donner une réponse plus vague, moins assurée — et un patient serait plus enclin à demander un avis complémentaire plutôt qu’à s’ancrer sur la conclusion.

Le compromis est réel : le raisonnement réduit le taux moyen d’hallucinations mais augmente la puissance de persuasion des hallucinations qui subsistent. Pour des tâches purement techniques (maths, code), c’est un échange acceptable. En médecine, le coût d’une erreur est asymétrique, et cela change le calcul.

Test de scénario : le même bilan biologique via R1 vs Wizey

Concrètement — un scénario que j’ai fait passer lors de l’évaluation technique.

Le bilan : un bilan réel (désidentifié) métabolique complet + NFS + ferritine + TSH + T4 libre + CRP + homocystéine + vitamine D + B12 + profil lipidique, 47 marqueurs au total. Plusieurs anomalies : ferritine élevée à 320 ng/mL, CRP modérément élevée à 8,5 mg/L, TSH près de la limite supérieure à 4,1 mUI/L, homocystéine à 14 µmol/L.

DeepSeek R1 via l’interface de chat (anglais, la langue la plus forte du modèle) :

- CoT d’environ 4 500 tokens, passant en revue chaque marqueur et construisant des associations.

- Conclusion finale : a signalé la ferritine comme « possible surcharge en fer ou inflammation chronique », l’a correctement liée à la CRP, mais a proposé l’hémochromatose comme diagnostic différentiel de première intention (une maladie génétique rare) à partir d’une seule valeur de ferritine.

- A interprété une TSH à 4,1 comme « dans la plage normale », manquant que 4,1 avec une homocystéine limite et une inflammation justifie un bilan d’anticorps anti-TPO et un contrôle à 6-8 semaines — le bilan standard de l’hypothyroïdie subclinique.

- L’homocystéine à 14 n’a pas été signalée comme nécessitant attention (beaucoup de laboratoires utilisent < 10 comme optimal).

- Le modèle a ajouté à plusieurs reprises la formule passe-partout « consultez un professionnel de santé », mais entre ces avertissements, il a émis des hypothèses très spécifiques sur un ton assuré.

Le même bilan via le pipeline Wizey :

- Les 47 marqueurs parsés dans un tableau structuré contre des plages de référence spécifiques à l’âge et au sexe.

- Ferritine avec CRP élevée interprétée correctement : écarter d’abord l’inflammation (comportement de marqueur de phase aiguë), puis envisager une surcharge en fer. L’hémochromatose n’est évoquée qu’après confirmation du coefficient de saturation de la transferrine et des tests génétiques — pas à partir d’une seule valeur de ferritine.

- TSH à 4,1 mise en évidence comme limite avec une recommandation explicite de re-tester avec des anticorps anti-TPO.

- Homocystéine à 14 signalée comme légèrement élevée avec la voie B12/folates/B6 et la suggestion de vérifier ces cofacteurs.

- Chaque énoncé est lié à une source précise du graphe de connaissances médicales (recommandations cliniques, références NCBI StatPearls sur les marqueurs de phase aiguë, revues Nature Medicine).

La différence, ce n’est pas que DeepSeek soit « moins malin » — c’est un modèle capable. La différence, c’est qu’un modèle de raisonnement généraliste n’a pas de garde-fous intégrés pour la conversion d’unités, le choix de la plage de référence ou une hiérarchie bayésienne d’hypothèses diagnostiques. Il raisonne. Wizey suit des protocoles — et n’utilise le raisonnement que là où un protocole vérifié dit que le raisonnement est approprié.

Quand DeepSeek R1 est le bon outil

Je veux être juste. Plusieurs scénarios où DeepSeek — en particulier déployé localement — est réellement le bon choix :

- Environnements cliniques ou R&D coupés du réseau (air-gapped). Si votre organisation a des exigences strictes de confidentialité, un R1-Distill-32B ou un R2 local sur votre propre serveur offre une qualité proche de la pointe sans envoyer le moindre octet à un tiers. C’est la voie la plus pratique vers la conformité HIPAA/RGPD avec un LLM de pointe.

- Base pour un fine-tuning de domaine. Les poids ouverts permettent aux groupes de recherche médicale de poursuivre le pré-entraînement sur des corpus cliniques validés et de bâtir leurs propres piles RLHF. Cette option n’existe pas pour les modèles fermés.

- Sous-tâches techniques dans un pipeline médical. Calculs de posologie, conversion d’unités, scores de risque comme CHA2DS2-VASc ou Wells — modules isolés de maths/logique où le raisonnement aide. À utiliser comme composant, pas comme « médecin ».

- Traduction et explication de terminologie — sur ce terrain, le modèle est au niveau des systèmes de pointe.

- Charges sensibles au coût — si vous devez exécuter des millions de requêtes, l’écart de prix avec les modèles de pointe fermés se chiffre en dizaines de milliers de dollars par mois.

Ce que je ne ferais pas : coller le PDF d’analyses d’un vrai patient dans le chat cloud DeepSeek et traiter la sortie comme une réponse clinique. Entre le flux de données transfrontalier, le mode d’échec « persuasif mais faux » de la CoT, l’absence de certification dispositif médical et le manque de discipline sur les plages de référence, c’est un mauvais choix pour le cas d’usage grand public. Pour un patient qui veut « envoyer son bilan à un bot et obtenir une réponse », un service médical conçu sur mesure est le bon outil.

Comment Wizey utilise le raisonnement — à l’intérieur d’un protocole, pas à la place

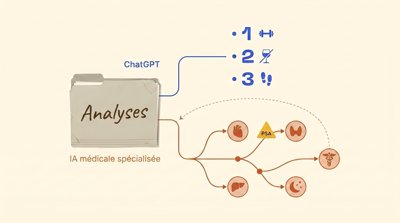

La question qui m’est le plus souvent posée : Wizey utilise-t-il aussi du raisonnement en interne ? Oui — mais encadré. Notre pipeline ressemble à ceci :

- OCR et extraction. Chaque valeur du PDF est parsée de façon déterministe et mappée vers un schéma structuré (de style LOINC) avec sa plage de référence spécifique au laboratoire.

- Liaison à la plage de référence. Chaque valeur est évaluée par rapport à la bonne plage pour l’âge, le sexe et (le cas échéant) la grossesse ou l’état rénal du patient. Ceci est du code, pas une sortie de LLM.

- RAG sur un graphe de connaissances cliniques validé. Chaque énoncé du rapport final est ancré dans une source précise — recommandation, article évalué par les pairs, entrée StatPearls — pas dans une génération libre.

- Raisonnement pour les chaînes diagnostiques, à l’intérieur de garde-fous. C’est ici que la pensée de type CoT fait son travail : construire un différentiel bayésien où le prior et la vraisemblance viennent du graphe de connaissances, pas de l’opinion du modèle.

- Sorties verrouillées par protocole. Le texte final est lié au résultat structuré. Le modèle n’a pas le droit d’inventer un diagnostic que le protocole n’a pas sanctionné.

Cette architecture fait deux choses à la fois. Elle capture le véritable avantage du raisonnement — logique diagnostique pas à pas, calculs sûrs en unités, conscience de la covariation entre marqueurs — tout en coupant le mode d’échec spécifique qui rend un modèle de raisonnement pur risqué en médecine : une chaîne de pensée longue, persuasive et cohérente en interne qui est fausse parce que les prémisses n’ont jamais été vérifiées.

Conclusion

DeepSeek est un travail techniquement impressionnant, et je suis sincèrement heureux que l’industrie dispose d’une alternative open source aux modèles de pointe fermés. Le déploiement local déverrouille des options de confidentialité et de fine-tuning que les utilisateurs de modèles fermés n’ont tout simplement pas, et cela compte pour les hôpitaux, les groupes de recherche et quiconque prend au sérieux la souveraineté des données.

Mais le raisonnement seul ne résout pas le problème médical. Une chaîne de pensée longue et bien formée sur de fausses prémisses reste une mauvaise réponse — juste mieux emballée. Pour la tâche consistant à lire les analyses d’un patient précis, où chaque chiffre, chaque plage de référence et chaque différentiel comptent, l’équipe Wizey a pris une autre voie : un pipeline spécialisé avec RAG sur des sources cliniques vérifiées et des garde-fous de protocole stricts. Pour le patient, cela se traduit par une promesse concrète — chaque énoncé du rapport peut être montré à un médecin et retracé jusqu’à une source.