🤖 Wizey vs Grok (xAI) — une IA en temps réel peut-elle gérer vos questions médicales ?

Quand je reçois des patients aujourd’hui, j’entends une nouvelle version d’une vieille question : « Docteure, j’ai demandé à Grok ce qu’il en pensait ». Parfois à propos d’un symptôme, parfois sur une valeur précise de leur bilan biochimique, parfois sur une posologie de médicament lue sur X. Grok est devenu une IA familière pour un type particulier d’utilisateur — le public technophile, natif de X, qui préfère son côté temps réel et sa disposition à répondre aux questions que d’autres chatbots déclinent poliment.

C’est précisément pour cela que je veux passer en revue honnêtement ce que Grok fait bien dans une conversation médicale et où se situent les garde-fous produit, techniques et réglementaires. Dans cet article, je regarde le modèle phare de xAI à travers le regard d’un clinicien : comment il se comporte sur les questions de santé, ce que sa recherche en temps réel vous apporte vraiment, et où vous devriez cesser d’attendre d’un assistant généraliste qu’il accomplisse un travail pour lequel il n’a jamais été conçu.

Je travaille dans l’équipe Wizey, j’ai donc un biais — j’évalue chaque IA à l’aune de la façon dont elle gère un bilan biologique. Mais ce biais met en lumière des choses qu’un utilisateur occasionnel ne verra pas : pourquoi un chatbot moins filtré et en temps réel est à certains égards plus dangereux en médecine qu’un chatbot poli, et pourquoi « Grok dit les choses telles qu’elles sont » est un slogan marketing, pas un fait clinique.

Grok en 2026 : temps réel, provocateur, toujours un LLM généraliste

Un cadrage technique rapide, car on parle parfois de Grok comme s’il s’agissait d’une nouvelle espèce d’IA. Ce n’en est pas une. Grok est la famille de grands modèles de langage de xAI (actuellement dans la classe Grok 3 / Grok 4 en 2026), entraînée sur un mélange de données du web public et du corpus des publications X, distribuée principalement via l’abonnement X Premium et l’API xAI.

Ce qui rend Grok distinctif sur le plan produit, ce sont trois choses. Premièrement, une intégration étroite avec X — on peut lui parler à l’intérieur de l’application où l’on fait défiler le fil, et il peut citer ou résumer des publications quasiment en temps réel. Deuxièmement, une politique de contenu « moins censurée » — xAI commercialise Grok comme plus disposé à s’engager sur des questions piquantes, politiques ou spéculatives. Troisièmement, une voix délibérément irrévérencieuse, inspirée en partie de l’esthétique du Guide du voyageur galactique.

Aucun de ces trois traits n’en fait un modèle médical. Sous le capot, Grok est un LLM généraliste avec les mêmes modes d’échec documentés partout dans le domaine — hallucinations, absurdités affirmées avec assurance, sensibilité à la formulation du prompt et effet Lost in the Middle, où une information enfouie au milieu d’un long contexte est sous-pondérée dans la sortie. Ce sont des propriétés de l’architecture transformer, pas d’un fournisseur en particulier. Tout ce que j’ai écrit dans la comparaison pilier Wizey vs ChatGPT à propos des LLM généralistes s’applique aussi à Grok. Je me concentrerai ici sur ce qui est spécifique à Grok : l’angle temps réel, la posture sur la politique de contenu et la distribution via X Premium.

Le problème du « moins censuré » — pourquoi c’est important en médecine

Avec ChatGPT ou Claude, la plainte la plus courante des utilisateurs avancés est que le modèle est trop prudent : il tempère, refuse ou renvoie vers un « consultez un médecin » même pour des questions éducatives bénignes. Grok se positionne explicitement à l’opposé. Il s’engage sur davantage de questions, donne des réponses qui sonnent plus directes et tempère moins.

Dans presque tous les domaines non médicaux, c’est un atout. En médecine, c’est un handicap.

Voici le mécanisme. Un chatbot poli qui refuse d’interpréter votre valeur de ferritine est pénible, mais il empêche aussi de vous donner avec aplomb la mauvaise réponse. Un chatbot qui répond joyeusement à la même question par un paragraphe à l’allure plausible peut être bien plus nocif, car l’utilisateur repart en croyant comprendre désormais son bilan. Le risque clinique réel est proportionnel à la confiance du modèle, pas à sa coopérativité. Moins de filtrage et un ton plus direct est une mauvaise combinaison pour un domaine où les mauvaises réponses peuvent se traduire par des diagnostics retardés.

Grok présente aussi les tendances flatteuses documentées sur les LLM de pointe — le modèle adapte souvent sa réponse à ce que l’utilisateur semble vouloir entendre. Demandez-lui « ma ferritine est à 800, c’est probablement juste de l’inflammation ? » et vous avez plus de chances d’obtenir une réponse qui opine que si vous demandez « ma ferritine est à 800, de quoi dois-je m’inquiéter ? ». Les recommandations de la Mayo Clinic sur les chatbots d’IA sont assez nettes à ce sujet : ces outils sont utiles pour l’éducation générale, pas pour l’interprétation diagnostique personnelle.

Recherche en temps réel : utile pour l’actualité, sans intérêt pour votre bilan

Le deuxième argument de vente de Grok est l’accès en temps réel à X et au web public. C’est réellement utile pour certaines questions. Si un médicament vient d’être retiré, si une épidémie est rapportée, si une nouvelle recommandation clinique est parue ce matin — Grok peut la remonter plus vite qu’un modèle dont la date de coupure d’entraînement est figée.

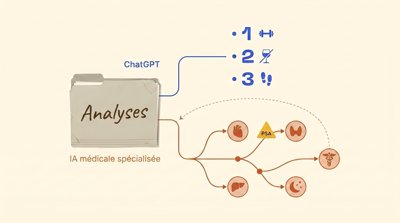

Pour interpréter votre bilan biologique, en revanche, la recherche en temps réel ne fait essentiellement rien. Votre bilan biochimique n’est pas sur internet. C’est un PDF privé généré par votre laboratoire précis, avec les valeurs de référence propres à ce laboratoire, la méthode de dosage précise qu’il a utilisée et la combinaison précise d’analytes qu’il a réalisée. Rien de tout cela n’est récupérable par recherche web. Ce qu’il vous faut réellement, c’est un parseur structuré qui extrait chaque ligne sous forme d’un quadruplet (paramètre, valeur, unité, plage de référence), normalise les unités entre laboratoires, et fait passer le résultat par des parcours cliniques validés. Les données web en temps réel ne peuvent remplacer aucune de ces étapes.

Dans certains cas, la recherche en temps réel aggrave la situation. Grok peut incorporer dans sa réponse des opinions issues de posts X et de fils de forums, et il est souvent difficile de distinguer dans la sortie quelle affirmation provient d’une source évaluée par les pairs, laquelle d’un tweet de médecin et laquelle d’un compte anonyme. The Lancet Digital Health et Nature ont tous deux publié sur la manière dont les LLM brouillent la provenance des affirmations médicales — avec une couche de récupération dominée par les réseaux sociaux, ce brouillage empire, il ne s’améliore pas.

Pas de BAA HIPAA, et les conditions de xAI excluent explicitement les conseils médicaux

La partie réglementaire est simple et courte. Le Grok grand public de xAI, distribué via X Premium, ne propose pas d’accord HIPAA de partenaire commercial. Cela signifie que Grok n’est pas un endroit légal pour téléverser des données patient identifiables dans un contexte de soins aux États-Unis. Pour l’UE, le RGPD traite les informations de santé comme des données de catégorie spéciale nécessitant des garanties explicites qu’un chatbot généraliste grand public ne peut pas fournir. Les recommandations de l’OMS sur l’IA pour la santé sont sans ambiguïté : les chatbots grand public ne remplacent pas les outils cliniquement validés.

Les conditions d’utilisation de xAI elles-mêmes excluent explicitement les conseils médicaux — les sorties de Grok ne sont pas destinées au diagnostic, au traitement ou à toute décision clinique, et xAI décline toute responsabilité pour un tel usage. Ce n’est pas un piège enfoui dans les petites lignes. C’est la posture juridique standard de tout éditeur de LLM grand public (OpenAI, Anthropic, Google, xAI) et il faut la prendre au pied de la lettre.

Ainsi, même si la réponse de Grok sur votre ferritine paraît plausible, l’éditeur vous a déjà dit, noir sur blanc, que vous ne pouvez pas vous y fier pour des décisions médicales. Cela suffit à traiter Grok comme un outil éducatif, pas clinique.

Là où Grok cale sur un bilan biologique réel

Soyons concrets sur ce qui casse quand on essaie d’utiliser Grok pour interpréter un bilan.

Pas de parseur structuré. Quand vous collez le texte d’un PDF dans Grok, il le lit comme un mur de mots, pas comme un tableau structuré. Les unités se mélangent (µg/L vs mg/L — un facteur mille dans la pratique), les plages de référence cessent d’être associées à la bonne ligne, les notes de méthode en bas de page sont ignorées. Sur cinq valeurs, cela fonctionne bien. Sur un bilan de 28 lignes, il commence à laisser tomber des chiffres.

Lost in the Middle sur des données structurées. Liu et al. 2023 (Stanford) ont documenté que les LLM sous-pondèrent les informations situées au milieu d’un long contexte. Sur un bilan de 30 paramètres, les analytes au milieu du document — précisément ceux qui pourraient compter — reçoivent le moins d’attention. En biochimie, c’est ainsi qu’une CRP élevée, une anomalie subtile de la formule sanguine ou une TSH qui dérive disparaissent discrètement du résumé.

Pas de parcours cliniques. Quand un système spécialisé voit une ferritine élevée, il est tenu de regarder aussi la CRP et la formule leucocytaire, car la ferritine est un marqueur de phase aiguë et la lire isolément est cliniquement faux. Grok ne connaît pas cet algorithme. Il peut interpréter la ferritine « au pied de la lettre » comme une surcharge en fer et recommander de réduire la viande rouge. La réponse paraît plausible. Cliniquement, c’est une erreur.

Pas de continuité entre visites. Grok n’assemble pas vos analyses de mars, juin et novembre en une seule ligne temporelle. Chaque conversation est essentiellement une page blanche. En médecine, la tendance sur trois visites est souvent plus informative qu’une valeur isolée.

Confiance sans calibration. Le ton moins filtré de Grok signifie moins de moments « je ne suis pas sûr » dans sa sortie, même lorsque l’incertitude est élevée. Un système qui paraît assuré à un non-expert mais se trompe souvent est pire qu’un système qui nuance à bon escient.

Rien de tout cela n’est une critique de xAI en tant qu’entreprise. C’est simplement la description de ce pour quoi un LLM généraliste est — et n’est pas — construit. Si j’avais à bâtir une IA sociale en temps réel, je ferais les mêmes arbitrages. Je ne lui confierais simplement pas un bilan biologique.

Scénario de test : ferritine à 812 via Grok face à un pipeline médical

Pour rester concret, j’ai passé le même cas par les deux outils. Une patiente de 38 ans, ferritine 812 ng/mL, CRP 14 mg/L, hémoglobine 121 g/L, NFS et bilan métabolique par ailleurs sans particularité.

Grok sur X Premium, trois valeurs collées dans le chat. La réponse a été un paragraphe assuré sur la surcharge en fer, le dépistage de l’hémochromatose, la mention de l’inflammation comme possible facteur de confusion et la recommandation « parler à un médecin en cas d’inquiétude ». Aucune phrase précise n’était fausse. Mais pas de hiérarchisation — le bilan d’hémochromatose et la correction d’un marqueur de phase aiguë sont des parcours cliniques très différents, et l’utilisateur doit deviner lequel s’applique. À la question de suivi « cela pourrait-il n’être que de l’inflammation ? », Grok a acquiescé, ce qui est exactement le problème de la flatterie.

Grok avec le PDF complet de 28 paramètres. Grok a lu la plupart des valeurs mais a manqué deux anomalies au milieu du bilan et n’a pas relié le bilan lipidique aux enzymes hépatiques. Le résumé de haut niveau était correct mais plat — sans hiérarchisation d’urgence, sans « voilà ce qu’il faut faire en premier ».

Le même bilan via un pipeline spécialisé (Wizey). Tableau structuré des 28 paramètres avec unités normalisées, écarts signalés, courbe de tendance si des bilans antérieurs existent, et liste d’actions priorisées : « à discuter en urgence avec un gastro-entérologue », « contrôle de routine à trois mois », « variante de la normale, pas d’action nécessaire ». Chaque affirmation du résumé clinique renvoie à une ligne précise du tableau extrait, si bien qu’un médecin peut l’auditer ligne par ligne. Ce n’est pas de la magie ; c’est une architecture différente. Wizey utilise OCR → extraction structurée → graphe de connaissances → parcours cliniques validés, et est conçu explicitement pour refuser plutôt qu’halluciner en cas de doute. Grok est conçu pour s’engager. Ce sont des produits différents pour des tâches différentes.

Quand Grok est le bon outil autour de la santé

J’avais promis une comparaison équitable. Grok a de vrais atouts et je l’utilise moi-même pour certaines choses.

- Éducation générale. « Qu’est-ce que la ferritine », « que mesure la CRP », « en quoi l’immunité induite par un vaccin diffère-t-elle de l’immunité naturelle » — Grok fait l’affaire ici. La rapidité et le ton sont un plus net pour l’apprentissage.

- Actualité santé en direct. Signalements d’épidémies, rappels de médicaments, résultats d’essais cliniques fraîchement annoncés — la recherche en temps réel et le flux de X sont un vrai avantage sur les modèles à date de coupure figée.

- Rédiger des questions pour votre médecin. Décrivez votre situation en langage naturel, demandez à Grok de produire cinq à sept questions tranchantes pour la consultation. Cela aide réellement — en tant que médecin, je préfère de loin un patient préparé à un patient non préparé.

- Traduire le jargon médical. « Explique ce compte rendu de sortie en français simple » est une tâche que tout LLM moderne, Grok compris, gère bien. C’est de la traduction, pas du diagnostic.

- Explorer un sujet de santé publique. Si vous voulez comprendre une nouvelle recommandation, une controverse sur une classe de médicaments, ou un débat sur X à propos d’un article clinique — l’accès en temps réel de Grok et sa disposition à s’engager dans la nuance sont utiles.

Ce que je ne ferais pas, c’est coller un PDF de mes propres analyses dans Grok et agir sur son interprétation. Non parce que Grok est « mauvais », mais parce qu’il est conçu pour un autre travail.

Mini-FAQ

Puis-je demander à Grok d’interpréter les résultats de ma prise de sang ? Techniquement, vous pouvez coller quelques valeurs dans le chat Grok sur X et recevoir une réponse. Mais les conditions d’utilisation de xAI excluent explicitement les conseils médicaux, Grok n’a pas d’accord HIPAA de partenaire commercial, et sa tendance connue à des réponses provocatrices, flatteuses ou spéculatives est exactement le mauvais comportement pour un bilan biologique. Pour un bilan complet de 20 à 30 paramètres, un LLM généraliste comme Grok n’est pas le bon outil.

Qu’est-ce que Grok et en quoi diffère-t-il de ChatGPT ? Grok est le grand modèle de langage phare de xAI, actuellement dans sa génération Grok 3/4 en 2026. Il est distribué principalement via X Premium (le palier payant du réseau social anciennement connu sous le nom de Twitter) et via l’API xAI. Par rapport à ChatGPT, Grok se positionne avec un accès en temps réel aux publications sur X et au web public, une politique de contenu moins restrictive et un ton délibérément provocateur. Sous le capot, il reste un LLM généraliste avec les mêmes limites d’hallucination et de raisonnement.

Grok est-il conforme à HIPAA ou au RGPD pour les données médicales ? Non. xAI ne propose pas d’accord HIPAA de partenaire commercial pour le Grok grand public sur X Premium, et téléverser des informations de santé identifiables dans n’importe quelle interface de chat grand public — Grok, ChatGPT, Gemini ou autres — n’est pas recommandé. La conformité RGPD pour les données de santé de catégorie spéciale exige une infrastructure explicite et des garanties contractuelles que le Grok grand public ne fournit pas.

La recherche web en temps réel rend-elle Grok plus sûr pour les questions médicales ? La recherche en temps réel aide pour les sujets qui évoluent vite, comme les rappels de médicaments ou les nouvelles d’épidémies, mais elle ne règle pas le problème central de l’interprétation des analyses. Votre prise de sang n’est pas sur internet — c’est un PDF privé d’un laboratoire particulier avec des valeurs de référence et des méthodes particulières. La recherche en temps réel ne peut pas remplacer un parseur structuré, la normalisation des unités ou des parcours cliniques. Elle peut même aggraver les choses en faisant remonter des messages de forum aléatoires comme preuves.

Quand Grok est-il vraiment utile autour de la santé ? Grok convient pour des questions d’éducation générale — qu’est-ce que la ferritine, que mesure la CRP, comment le système immunitaire répond à un virus. Il est aussi utile pour l’actualité en direct sur des événements de santé publique, des pénuries de médicaments ou des annonces réglementaires où la fraîcheur importe. Mais interpréter votre bilan biologique précis avec ses chiffres et décider de la suite est une tâche différente — conçue pour un pipeline médical spécialisé, pas pour un chatbot généraliste.

Conclusion

Grok est un LLM généraliste capable et distinctif, avec de vrais atouts — accès en temps réel à X, disposition à s’engager sur des questions que d’autres modèles déclinent, et une prose réellement rapide et fluide. Pour l’éducation santé générale, pour suivre l’actualité en direct sur la médecine, pour préparer des questions avant une consultation, il fonctionne bien, et je n’ai aucun mal à le recommander dans ce cadre.

Mais interpréter un vrai bilan biologique est un autre métier. Ce métier exige un parsing strict de chaque valeur, la normalisation des unités et des plages, la couture entre les visites pour en faire une vraie ligne temporelle, et de fonctionner à l’intérieur de parcours cliniques validés plutôt que de générer du texte libre. Nous avons conçu Wizey exactement pour cela — pas un énième chatbot généraliste, mais un pipeline spécialisé pour les documents médicaux, pensé pour refuser plutôt qu’halluciner en cas de doute. Si vous avez un bilan biologique en main que vous voulez décoder sans perdre un seul chiffre, c’est l’outil construit pour la tâche.