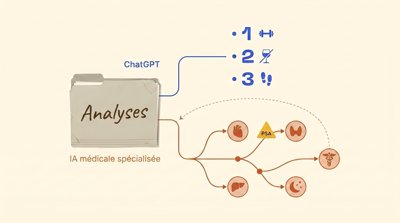

🤖 Wizey vs Microsoft Copilot : Office Copilot peut-il interpréter les résultats d'analyses ?

Au cours de la dernière année, j’ai observé une évolution claire dans la façon dont les patients se préparent aux consultations. Là où les gens apportaient des impressions de ChatGPT, une part croissante apporte maintenant des captures d’écran de Microsoft Copilot — la petite icône bleue qui vit dans Word, Outlook, Teams et la barre des tâches Windows. Lorsque votre employeur déploie Microsoft 365 Copilot et qu’il est juste là, à un clic, cela semble être l’endroit raisonnable pour déposer un PDF d’analyses. Il est intégré. Il est de qualité entreprise. Il vient de Microsoft.

En tant que médecin, j’ai des sentiments mitigés à ce sujet. Copilot est un assistant véritablement capable, et pour la gouvernance des données d’entreprise, c’est sans doute l’IA proche du grand public la plus étroitement encadrée disponible. Mais « étroitement encadrée pour l’entreprise » et « sûre pour l’interprétation clinique » sont deux affirmations très différentes. Dans cet article, je veux démêler cette distinction honnêtement.

J’ai couvert les limites générales des grands modèles de langage pour l’interprétation d’analyses dans l’article pilier Wizey vs ChatGPT. Ici, je me concentre sur ce qui est spécifique à Microsoft Copilot — le backend Azure OpenAI, l’intégration Microsoft Graph, les garanties de protection commerciale des données, et ce qu’elles signifient et ne signifient pas lorsqu’un panel de 45 marqueurs atterrit dans la fenêtre de chat.

Ce qu’est réellement Microsoft Copilot en 2026

Microsoft Copilot n’est pas un produit unique. C’est une marque qui couvre au moins quatre niveaux significativement différents.

Copilot (grand public) est l’assistant de chat gratuit sur copilot.microsoft.com et dans Windows 11. Il fonctionne avec des modèles de la classe GPT-4o et GPT-5 hébergés dans Azure OpenAI, avec vision multimodale et ancrage web via Bing. Il n’a pas d’Accord de partenariat commercial et les conditions de service grand public standard s’appliquent.

Copilot Pro est le niveau grand public payant (environ 20 $/mois) qui ajoute un accès prioritaire, des modèles d’image avancés et une intégration légère aux applications personnelles Microsoft 365. Toujours des conditions grand public. Toujours pas de BAA.

Microsoft 365 Copilot est la licence entreprise vendue par poste aux organisations. C’est celle qui apparaît dans Word et Outlook professionnels. Elle s’appuie sur Azure OpenAI, intègre le contexte Microsoft Graph (les fichiers, messagerie, calendrier, Teams de votre locataire) et fonctionne sous des conditions de protection commerciale des données. Selon la documentation officielle de confidentialité de Microsoft, les prompts et les réponses sont chiffrés en transit et au repos, restent à l’intérieur du périmètre du service Microsoft 365, et ne sont pas utilisés pour entraîner les modèles fondamentaux.

Copilot pour M365 dans les locataires de santé ajoute la couverture HIPAA lorsque le client a un Accord de partenariat commercial en place avec Microsoft. C’est la seule édition contractuellement positionnée pour les Informations de santé protégées.

L’essentiel à comprendre pour les patients est que le Copilot gratuit sur votre ordinateur portable à la maison et le Copilot entreprise dans le système de votre hôpital sont des produits très différents d’un point de vue de conformité — même si la fenêtre de chat a l’air identique.

Là où Copilot est véritablement fort

Je veux être juste. Copilot a de réels avantages par rapport à une session ChatGPT naïve pour quiconque vit dans l’écosystème Microsoft.

Le chiffrement des données en vol et l’isolation du locataire pour le Copilot M365 entreprise sont réels. C’est l’une des rares expériences d’IA proches du grand public où, au niveau entreprise, vous avez une clarté contractuelle que vos prompts ne fuiront pas dans l’entraînement du modèle. Pour une organisation évaluant l’IA pour les opérations cliniques, cela compte énormément.

Parsing structuré de documents. Copilot hérite du pipeline Office pour lire Word, PDF et Excel. En pratique, cela signifie qu’un PDF d’analyses bien scanné est lu plus proprement qu’il ne le serait dans une fenêtre de chat nue — le côté Office du produit apporte une gestion des documents réels que les chatbots purs n’ont pas.

Contexte Microsoft Graph pour le workflow. Si votre tâche est « résumer les trois courriels les plus récents sur mon IRM du genou du cabinet de mon médecin », Copilot brille vraiment. Il peut assembler des événements de calendrier, des fils Outlook et des pièces jointes OneDrive d’une manière qu’aucun LLM autonome ne peut. C’est l’argument principal de Microsoft, et il est légitime pour le travail de bureau.

Derniers modèles fondamentaux, rapidement. Comme Copilot fonctionne sur Azure OpenAI, il bénéficie des mises à jour de la classe GPT-4o/GPT-5 avec des SLA entreprise. Vous n’obtenez pas un modèle périmé caché derrière la marque Microsoft — vous obtenez essentiellement la famille GPT frontalière avec des garde-fous commerciaux.

Là où Copilot échoue sur les tâches médicales

Maintenant la liste honnête — celle que je vois en consultation.

Les hallucinations sont de l’architecture, pas un bug. Un LLM généraliste optimise pour la plausibilité, pas pour la vérité. J’ai lu des captures d’écran de patients où Copilot commentait avec assurance un « magnésium légèrement bas » qui n’était tout simplement pas sur le panel prescrit, ou inventait une plage de référence pour un marqueur tumoral qui ne correspondait pas au pied de page réel du laboratoire. Cela correspond à ce que la revue de 2023 de Nature Medicine sur les LLM en médecine et une étude de 2024 de Lancet Digital Health sur le raisonnement diagnostique des LLM décrivent : des résultats plausibles avec un taux d’erreur cliniquement inacceptable sur des cas numériques spécifiques. Faire passer le même modèle par la marque Microsoft ne change pas ses modes de défaillance.

Lost in the Middle sur les longs panels. L’effet documenté par Liu et al. (2023) est universel pour les architectures transformer, et GPT-4o ne fait pas exception. Lorsqu’un patient colle un panel métabolique complet de 50 marqueurs plus thyroïde plus études du fer plus vitamine D, Copilot commentera en détail les premières valeurs et les dernières, tandis que les marqueurs enfouis au milieu — souvent précisément les indices inflammatoires ou métaboliques subtils — reçoivent une phrase générique ou sont silencieusement passés sous silence. L’enrobage Office ne corrige pas cela.

Pas de raisonnement systématique entre marqueurs. Une interprétation compétente dépend presque toujours de combinaisons. La ferritine doit être lue à la lumière de la CRP car la ferritine est elle-même une protéine de phase aiguë. La TSH doit être lue avec la T4 libre et parfois les anticorps anti-TPO. La glycémie à jeun va avec l’HbA1c et l’insuline. Copilot commente chaque valeur d’une liste, mais il n’a pas de graphe de connaissances cliniques qui encode ces relations comme des règles strictes. Deux utilisateurs avec les mêmes chiffres peuvent obtenir deux histoires différentes selon la formulation.

Le contexte Microsoft Graph est le mauvais contexte. Votre calendrier et vos fils Outlook n’aident pas Copilot à interpréter vos analyses. Il n’y a pas d’intégration aux dossiers de santé électroniques natifs FHIR pour l’expérience grand public, pas d’accès à vos panels précédents à moins de les joindre manuellement, et pas de base de données d’intervalles de référence intégrée qui connaisse la méthode d’essai de votre laboratoire spécifique. L’intégration entreprise est impressionnante — mais pour cette tâche, ce n’est pas l’intégration qui compte.

Microsoft elle-même dit que le médical est hors périmètre. Le Microsoft Responsible AI Standard souligne explicitement que les scénarios médicaux conséquents nécessitent une évaluation spécialisée au-delà de ce qu’offre un Copilot général. Les conditions de service grand public de Copilot réitèrent qu’il n’est pas un dispositif médical et n’est pas destiné au diagnostic médical.

HIPAA, BAA et l’écart grand public-entreprise

C’est là que la plupart des patients et pas mal de cliniques de taille moyenne se perdent. Laissez-moi l’énoncer clairement.

Le Copilot grand public n’a aucune couverture HIPAA. Lorsque vous vous connectez avec un compte Microsoft personnel sur copilot.microsoft.com et collez votre PDF d’hémogramme, vous utilisez un produit grand public. Il n’y a pas d’Accord de partenariat commercial entre vous et Microsoft. Vos données ne sont pas des Informations de santé protégées au sens réglementaire car vous, le patient, les divulguez volontairement — mais le service n’a aucune obligation HIPAA de les protéger en tant que PHI. Les directives HIPAA sur l’informatique en nuage de HHS de Microsoft sont claires sur l’endroit où s’appliquent les obligations.

Le M365 Copilot entreprise avec un BAA est une autre histoire. Si votre clinique a une licence Microsoft 365 entreprise avec un BAA signé, les prompts et les réponses via M365 Copilot peuvent relever des garanties HIPAA. Les données vivent dans le locataire du client, sont chiffrées en transit et au repos, et sont explicitement exclues de l’entraînement des modèles fondamentaux. C’est une posture de gouvernance solide — mais cela ne dit rien sur la question de savoir si la sortie du modèle est cliniquement correcte. Le BAA est un contrat sur la gestion des données. Ce n’est pas une validation de la précision médicale.

RGPD et le côté UE. Pour les patients de l’UE, M365 Copilot offre des options de résidence des données qui maintiennent les prompts à l’intérieur des limites européennes. Encore une fois, cela aborde l’endroit où les données sont stockées, pas si l’interprétation est correcte.

Version courte : le Copilot entreprise à l’intérieur d’un locataire de santé est bien mieux gouverné que le ChatGPT public. Cela n’en fait pas un dispositif médical. Gouvernance et validité clinique sont des axes différents.

Un test réaliste : panel exécutif de 45 marqueurs via Copilot entreprise

Pour ancrer cela dans une expérience concrète, j’ai effectué un test raisonnable. J’ai pris un PDF anonymisé d’un panel d’examen exécutif de 45 marqueurs — hémogramme avec différentielle, CMP, bilan lipidique complet, panel thyroïdien, études du fer dont la ferritine, 25-OH vitamine D, homocystéine, hs-CRP, HbA1c — et je l’ai déposé dans Microsoft 365 Copilot à l’intérieur d’un locataire entreprise de test.

Ce qui a bien fonctionné. L’OCR était propre. Copilot a correctement parsé les noms de marqueurs et les unités, n’a pas confondu mg/dL avec mmol/L, et a organisé la réponse par système anatomique. Le premier panel (hémogramme) a reçu un commentaire réfléchi. Les derniers marqueurs (HbA1c, vitamine D) ont également reçu du détail. Cette courbe d’attention en U est exactement ce que prédit la littérature Lost-in-the-Middle.

Ce qui a cassé. Le milieu du rapport — spécifiquement une ferritine élevée à côté d’une hs-CRP élevée — n’a pas été intégré. Copilot m’a dit que la ferritine était haute et a recommandé d’enquêter sur une surcharge en fer. Séparément, il m’a dit que la hs-CRP était élevée et a mentionné l’inflammation. Il n’a jamais connecté les deux, ce qui est le geste de manuel qu’un clinicien compétent fait en premier : une élévation de la ferritine de phase aiguë suit l’inflammation avant de suivre le fer.

Échec de reproductibilité. J’ai rejoué le même PDF dans un nouveau chat avec une formulation légèrement différente. L’homocystéine est passée de « dans les limites normales » à « à l’extrémité supérieure — envisager B12 et folate ». Même nombre, même plage de référence, histoire différente. Pour un document médical, c’est inacceptable — on ne peut pas construire de décisions cliniques sur des sorties stochastiques.

Aucune vue longitudinale. Copilot n’a aucune mémoire entre les sessions de chat sur les analyses antérieures à moins que vous ne joigniez manuellement chaque PDF antérieur. Il n’y a pas de concept de tendance. Votre HbA1c passant de 5,4 à 5,7 à 5,9 sur trois ans — le signal lent qui compte vraiment — est invisible à moins que vous ne l’alimentiez à la main.

En revanche, un pipeline d’interprétation d’analyses dédié parse chacun de ces 45 marqueurs en un objet structuré (nom, valeur, unités, référence, date de prélèvement, méthode), puis une couche de raisonnement déterministe parcourt le tableau en appliquant des règles cliniques codées. Ferritine-plus-CRP est une règle, pas un choix stylistique. Les tendances sur plusieurs années sont de première classe. La sortie est reproductible parce que la logique est reproductible.

Quand Copilot est le bon outil dans un workflow médical

Je ne veux pas que cela se lise comme « Copilot est mauvais, ne l’utilisez jamais ». Ce n’est pas le message. Copilot excelle dans plusieurs tâches adjacentes.

Résumer un article médical auquel vous faites déjà confiance. Si votre endocrinologue vous a envoyé un PDF de guideline et que vous voulez l’essentiel en 300 mots, Copilot est parfait.

Rédiger une liste de questions pour votre rendez-vous. Donnez-lui vos symptômes et contexte, demandez cinq questions à apporter à votre cardiologue. Cela joue sur les points forts du modèle — génération structurée sur du contenu non numérique — sans aucun dommage possible.

Traduire un rapport de laboratoire étranger. Analyses de vacances en italien, hébreu ou japonais ? Copilot traduira proprement le texte narratif et les étiquettes d’unités. Associez cela à un outil spécialisé pour l’interprétation réelle.

Transformer une note de consultation en un résumé lisible. Si votre clinicien partage un résumé post-visite plein d’abréviations, Copilot peut le réécrire en anglais clair pour vos dossiers.

Administration santé adjacente au bureau. Rédiger un courriel pour demander une référence, résumer la correspondance d’assurance, transformer une discussion Teams de votre plan de soins en points clés — exactement les workflows pour lesquels Microsoft Graph a été construit.

Ce qui n’a pas sa place dans Copilot : l’interprétation directe d’un panel multi-marqueurs, le suivi longitudinal sur plusieurs années de données, les décisions de dosage ou de médicament, l’interprétation des marqueurs tumoraux limites ou des profils hormonaux, ou tout ce qui nécessite un raisonnement clinique déterministe.

Face à face : Wizey vs Microsoft Copilot

| Dimension | Wizey | Microsoft Copilot (M365 Enterprise) |

|---|---|---|

| Objectif | Conçu spécifiquement pour l’interprétation d’analyses | Assistant de productivité généraliste |

| Modèle fondamental | Graphe de connaissances médicales + pipeline LLM validé | Classe GPT-4o / GPT-5 via Azure OpenAI |

| Traitement de documents | Parsing structuré en objets typés par marqueur | Texte libre + vision sur le PDF |

| Raisonnement clinique | Voies cliniques codées, règles déterministes | Prédiction statistique du prochain token |

| Liens entre marqueurs (ferritine/CRP, TSH/T4) | De première classe, toujours évalués | Non modélisés |

| Suivi longitudinal | Natif, détection automatique des tendances | Aucun ; nécessite un attachement manuel |

| Risque d’hallucination | Encadré par extraction structurée et vérifications de règles | Élevé sur les cas numériques limites |

| Reproductibilité | Même entrée produit même sortie | Stochastique ; même entrée, réponses différentes |

| HIPAA / BAA | Contrôles de qualité médicale intégrés | BAA disponible uniquement sur le niveau entreprise |

| RGPD / résidence UE | Disponible | Disponible au niveau entreprise |

| Entraînement sur les données utilisateur | Jamais | Pas pour l’entreprise ; les conditions grand public s’appliquent pour le niveau gratuit |

| Intégration Microsoft Graph | Sans objet | Oui (sans rapport avec l’interprétation d’analyses) |

Un court algorithme pour les patients

Si vous avez déjà Microsoft 365 au travail ou à la maison :

- Utilisez Copilot pour ce en quoi il excelle : résumer, rédiger, traduire, workflow Office.

- N’utilisez pas le Copilot grand public pour interpréter des panels d’analyses numériques. Le seul écart BAA est une raison de s’arrêter.

- Si vous utilisez le M365 Copilot entreprise dans une clinique avec un BAA, traitez son commentaire d’analyses comme une aide à la lecture approximative, pas comme une sortie clinique. Vérifiez chaque nombre qu’il cite par rapport au PDF réel.

- Pour l’interprétation réelle — motifs de ferritine, lecture thyroïdienne, ratios lipidiques, statut vitaminique sur plusieurs années — utilisez un outil dédié qui parse les valeurs en données structurées et applique des règles cliniques validées.

- Apportez la sortie structurée à votre médecin. L’objectif est d’arriver à la consultation préparé, pas de remplacer la consultation.

Mini-FAQ

Microsoft Copilot est-il conforme à HIPAA pour téléverser mon bilan sanguin ? Cela dépend de l’édition. Microsoft 365 Copilot pour les clients entreprises est couvert par l’Accord de partenariat commercial de Microsoft lorsqu’un BAA valide est en place, et les données du locataire ne sont pas utilisées pour entraîner les modèles fondamentaux. Le Copilot grand public gratuit n’est PAS couvert par un BAA, n’est pas destiné aux Informations de santé protégées, et les propres conditions de Microsoft déconseillent son usage clinique.

Copilot peut-il lire correctement un PDF multi-panels comme un CMP ou un bilan thyroïdien complet ? Copilot utilise la vision multimodale de la classe GPT-4o via Azure OpenAI et gère raisonnablement bien les PDF propres et bien structurés. Mais sur des panels denses de 40 à 60 marqueurs, il se heurte au même problème Lost-in-the-Middle que n’importe quel LLM transformer : les valeurs aux extrémités reçoivent des commentaires précis, tandis que les marqueurs au milieu du document sont résumés à un niveau plus élevé ou, occasionnellement, fabriqués. Il n’a pas non plus de mécanisme pour croiser la ferritine avec la CRP, ou la TSH avec la T4 libre.

Et le contexte Microsoft Graph — cela ne rend-il pas Copilot plus intelligent pour la santé ? Microsoft Graph donne à Copilot accès à vos courriels, documents, discussions Teams et calendrier — ce qui est utile pour la productivité au travail, mais n’apporte aucun contexte clinique. Il ne se connecte pas à un graphe de connaissances médicales, ne connaît pas les intervalles de référence pour votre test et ne peut pas raisonner sur les voies physiologiques.

Copilot est-il plus sûr que ChatGPT pour les données de santé dans un environnement d’entreprise ? Pour la gouvernance des données — oui, le Copilot M365 entreprise garde les données du locataire à l’intérieur du périmètre du service Microsoft 365, chiffre en transit et au repos, et n’entraîne pas les modèles fondamentaux sur les prompts du locataire. Pour la précision médicale — non. Le modèle sous-jacent est un LLM généraliste avec le même profil de risque d’hallucination que tout autre déploiement GPT-4o.

Quand est-il judicieux d’utiliser Copilot pour des sujets de santé ? Résumer des articles auxquels vous faites déjà confiance, rédiger des questions pour votre médecin, traduire un rapport de laboratoire étranger ou transformer une note de consultation en un résumé lisible. Pour l’interprétation numérique directe d’un panel de plus de 40 marqueurs ou le suivi longitudinal, un outil dédié est plus sûr.

La conclusion

Microsoft Copilot est un produit d’IA d’entreprise sérieux avec des atouts légitimes : de réelles garanties de gouvernance pour les clients commerciaux, une intégration Office propre, des modèles GPT frontaliers fonctionnant sous des conditions commerciales. Pour rédiger, résumer, traduire et le workflow, il est excellent.

Pour la tâche spécifique d’interprétation de vos résultats d’analyses, Copilot reste un LLM généraliste. Il hérite de toutes les limites que nous avons documentées à travers la littérature LLM — hallucinations sur les bords numériques, Lost-in-the-Middle sur les longs panels, pas de logique systématique entre marqueurs, sortie stochastique sur des entrées identiques. Le backend Azure, le contexte Microsoft Graph et le BAA entreprise ne corrigent pas ces limites. Ils adressent des problèmes différents.

Dans l’équipe Wizey, nous construisons un outil qui fait exactement une chose bien : transforme votre PDF d’analyses en une interprétation structurée, reproductible et consciente de la dimension longitudinale, encadrée par des voies cliniques validées. Ce n’est pas un remplacement pour votre clinicien. C’est la façon d’entrer dans la salle de consultation préparé, avec les bonnes questions déjà en main.